L’adozione di modelli Transformer ottimizzati per le OPT consente di valorizzare un esame già ampiamente integrato nella pratica odontoiatrica, senza richiedere modifiche sostanziali al flusso di lavoro.

Osservare una radiografia panoramica significa confrontarsi con un’immagine densa di informazioni: denti, radici, ossa e strutture anatomiche si intrecciano in una rappresentazione complessa che richiede esperienza e attenzione per essere interpretata correttamente. Nella pratica clinica quotidiana questa lettura è affidata all’occhio dell’odontoiatra, ma oggi a questo processo si affianca un nuovo alleato: l’intelligenza artificiale. Spezziamo subito una lancia a favore: non si tratta di sostituire il giudizio umano, bensì di affiancarlo con strumenti capaci di analizzare le immagini in modo sistematico, coerente e riproducibile. L’integrazione dell’intelligenza artificiale nell’analisi delle ortopantomografie (OPT) nasce dall’esigenza di migliorare l’affidabilità dello screening e di supportare l’individuazione precoce di alterazioni radiografiche spesso difficili da riconoscere. In questo contesto, i modelli basati su meccanismi di attenzione rappresentano un’evoluzione significativa nel modo di interpretare le immagini dentali.

Le opt tra visione globale e complessità interpretativa

Le radiografie panoramiche sono ampiamente utilizzate in odontoiatria perché consentono di visualizzare l’intero apparato dento-maxillo-facciale in una singola acquisizione. Questa visione d’insieme le rende particolarmente utili nelle visite iniziali, nei controlli di routine e nei programmi di screening. Tuttavia, la ricchezza informativa delle OPT comporta anche alcune criticità: sovrapposizioni anatomiche, variazioni di contrasto e distorsioni possono mascherare segni patologici sottili, soprattutto nelle fasi iniziali delle lesioni. Di conseguenza, l’interpretazione delle OPT rimane fortemente dipendente dall’esperienza dell’operatore e soggetta a variabilità interindividuale. Queste limitazioni hanno stimolato un crescente interesse verso soluzioni automatiche in grado di fornire un supporto oggettivo e standardizzato alla lettura delle immagini.¶

L’intelligenza artificiale come supporto alla lettura radiografica

I sistemi di intelligenza artificiale applicati all’imaging dentale si basano sull’addestramento di modelli di deep learning mediante numerosi insiemi di radiografie refertate da esperti. Durante questa fase, il modello apprende a riconoscere configurazioni visive ricorrenti come variazioni di densità, irregolarità dei contorni e pattern strutturali, associandole alla presenza di specifiche condizioni patologiche. Una volta completato l’addestramento, il sistema è in grado di analizzare nuove OPT e di segnalare automaticamente le regioni che presentano caratteristiche sospette, fornendo una stima probabilistica della loro rilevanza clinica. Il risultato non è una diagnosi autonoma, ma un supporto decisionale che aiuta il clinico a orientare l’attenzione e a ridurre il rischio di omissioni, migliorando al contempo la coerenza interpretativa.

Dai modelli convoluzionali ai modelli transformer: il ruolo della self-attention

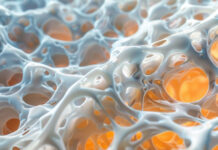

I primi approcci di deep learning applicati all’imaging odontoiatrico si sono basati prevalentemente su reti neurali convoluzionali (CNN), che hanno dimostrato una notevole efficacia nell’estrazione automatica di caratteristiche locali dall’immagine, come bordi, texture e variazioni di densità. Tuttavia, questa capacità di analisi locale rappresenta anche un limite strutturale: le CNN faticano a modellare in modo esplicito le relazioni a lunga distanza tra regioni separate dell’immagine, un aspetto particolarmente rilevante nelle radiografie panoramiche, dove elementi dentari anche distanti tra loro possono essere clinicamente correlati.

I modelli Transformer superano questa limitazione introducendo il meccanismo di self-attention, che consente di considerare simultaneamente tutte le regioni dell’immagine e di valutarne l’importanza relativa all’interno di un contesto globale condiviso. In questo modo ogni porzione dell’immagine viene interpretata non in modo isolato ma in relazione a tutte le altre, permettendo al modello di distinguere più efficacemente tra reali segni patologici e variazioni dovute a sovrapposizioni anatomiche o artefatti radiografici. Nel Vision Transformer (ViT), l’immagine viene suddivisa in piccole porzioni regolari, trattate come una sequenza analoga alle parole in un testo, sulle quali il meccanismo di self-attention opera per catturare relazioni spaziali a lungo raggio. Architetture più recenti, come lo Swin Transformer, estendono questo approccio introducendo una struttura gerarchica basata su finestre di attenzione locali che si spostano progressivamente, combinando così la comprensione del contesto globale con una maggiore efficienza computazionale e una migliore sensibilità ai dettagli fini dell’immagine.

Implicazioni cliniche e prospettive applicative

L’adozione di modelli Transformer ottimizzati per le OPT consente di valorizzare un esame già ampiamente integrato nella pratica odontoiatrica, senza richiedere modifiche sostanziali al flusso di lavoro. L’analisi automatica, eseguita in tempi molto ridotti, può evidenziare rapidamente le aree che richiedono approfondimenti, supportando la decisione su eventuali esami complementari e migliorando l’efficienza complessiva del percorso diagnostico. Questi sistemi devono essere considerati strumenti di supporto e non sostituti del giudizio clinico: il loro valore principale sta nella riduzione della variabilità interpretativa e nell’aumento della sensibilità nell’individuazione precoce delle patologie. Inoltre, un rilevamento più tempestivo può favorire interventi preventivi meno invasivi, contribuendo a contenere la spesa sanitaria e a ridurre i costi a lungo termine legati a trattamenti più complessi. In prospettiva, l’integrazione dell’intelligenza artificiale basata su meccanismi di attenzione potrà promuovere un’odontoiatria più assistita, preventiva e orientata alla qualità delle cure.